hpc2009 partíció installáláskori mérései

memtest86+

Még az oprendszer installálás elött, amilyen hamar csak lehetett a memtest86+ programot futtattuk minden node-on egyszerre. Addig futtattuk, amíg nem végeztünk az oprendszer installálásával. Cca 2 hétig futott minden node-on a teszter, hiba nélkül.

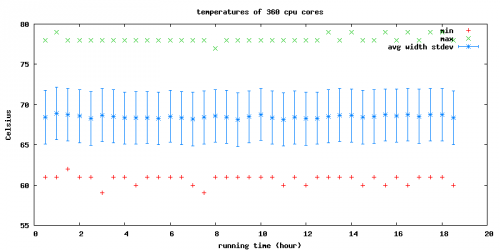

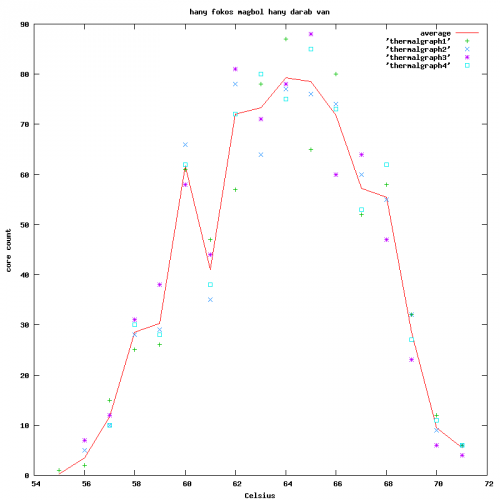

Áramellátás és klímatechnikai mérés

Ha a környezet nem tudja hatékonyan hűteni azokat, akkor a CPU visszavesz a frekvenciából, a számítási teljesítményből. Ha ez sem elegendő, akkor a CPU lekapcsolja magát, így védekezik a tönkremenetel ellen. Ez a frekvencia-visszavétel azt jelenti, hogy a hőtechnikai problémák egy ideig nem feltűnőek, szimplán csak a teljesítmény nem adja a maximumot.

A hpc2009 telepítésekor fokozottan ügyeltünk a hőtechnikai jóságra. A rendszer egyetlen rackben, mintegy 22U helyen fűt el cca 10kW teljesítményt, ezt nem olyan nyilvánvaló megoldani. A tesztüzem alatt 'cpuburn' csomaggal terheltük a cpu-kat, a fogyasztást és a hőmérsékletváltozást figyelve.

Interconnect teszt

Kipróbáltuk, hogy a switch tényleg tudja-e minden portján a gigabitet. Egyszerre. Ehhez párba állítottuk a gépeket, és mindegyik pingette a párját a switchen keresztül. El lehetett érni e 44 port mindegyikén a gigabit terhelést. (full duplex: egy gigabit oda, egy vissza).

Az első próbaszámolás, john-the-ripper

A rendszer összefaragásakor a teljes oprendszer-interconnect teszteléshez egy egyedi, érdekes informatikai feladatot választottunk, a jelszótörést. Ez még a queue rendszer és az MPI köztesréteg felkonfigurálása elötti teszt, hogy az oprendszer szintű funkcionalitások mennek-e. A teszt részletesen dokumentálva lett a hup.hu portálon.